-

Postów

9 964 -

Dołączył

-

Ostatnia wizyta

-

Wygrane w rankingu

41

Typ zawartości

Profile

Forum

Blogi

Wydarzenia

Galeria

Pliki

Sklep

Articles

Market

Community Map

Odpowiedzi opublikowane przez MateuszW

-

-

Ja w takim samym zestawieniu , ale z Nikonem , najlepsze efekty uzyskałem z przedłużką 7,5mm ( zamiast tej twojej 17mm). Gdzieś czytałem , że ktoś przy Canonie dał 10mm przedłużkę i było ok.

Canon ma nieco mniejszy backfocus.

-

Po wpłacie jednak musisz się upominać o swój z góry zapłacony towar, bo pomimo zapewnień jego zamiaru wysłania zaraz na drugi dzień po odnotowaniu wpłaty na koncie, i pomimo kolejnych mijających dni, towar wciąż jakoś nie przychodzi,

Niestety taka już specyfika Janusza, że jak towar jest lub łatwo go sprowadzić, to wszystko jest w porządku, ale jak coś już nie idzie, nie ma skąd sprowadzić albo inne problemy się pojawiają, to zaczyna się ściemnianie i odwlekanie, czasami bardzo długie. Zamiast przyznać wprost: "Nie mam towaru, nie dam rady sprowadzić, sprowadzanie potrwa miesiąc", to wymyślanie kolejnych wymówek, które przynoszą odwrotny efekt i zdenerwowanie klienta. Sam znam sprawę, gdzie na produkt za około 2000 zł trzeba było czekać jakieś 4 miesiące (bo właśnie nie miał skąd go sprowadzić i zaczęły się wymówki). Ale jeśli akurat nie mamy pecha, to wszystko idzie szybko i przyjemnie. Tego typu przypadki są raczej rzadkością, choć nie powinny się zdarzać wcale.

-

Zdecydowanie tak

Ja również się zgadzam

U mnie najczęściej obróbka idzie od Maxima przez Pixa aż do PSa, bo każdy ma swoje zalety i fajne cechy. Dobrze to ująłeś, że PS daje ogromne, w zasadzie nieograniczone możliwości, ale czasem bardziej specjalizowany soft może coś specyficznego zrobić szybciej i efektywniej.

U mnie najczęściej obróbka idzie od Maxima przez Pixa aż do PSa, bo każdy ma swoje zalety i fajne cechy. Dobrze to ująłeś, że PS daje ogromne, w zasadzie nieograniczone możliwości, ale czasem bardziej specjalizowany soft może coś specyficznego zrobić szybciej i efektywniej.Ja bardzo dużo korzystam z Twoich tutoriali, bo mam na razie dość dziwny, choć w miarę skuteczny sposób obróbki

Wiele rzeczy robię w siermiężny sposób, jakoś okrężnie, bo brakuje mi wiedzy o różnych fajnych trikach z warstwami itp.

Wiele rzeczy robię w siermiężny sposób, jakoś okrężnie, bo brakuje mi wiedzy o różnych fajnych trikach z warstwami itp.-

2

2

-

-

Kolejny świetny filmik, dzięki!

Będę miał kilka uwag/wątpliwości, ale to muszę jeszcze raz oglądnąć z notesem

Co do wyrównywania tła, to jeśli nie mamy jakiś patologicznych przypadków, to dużo szybciej i wygodnie jest w Pix LE to zrobić: https://astronomiaamatorska.blogspot.com/2010/06/pixinsight-le-10-wyrownanie-ta.html. Tam odpowiednik calculations działa na wszystkie kanały

-

Były wzmianki na forum kilka razy, choć brak oficjalnego wątku z zaproszeniem

-

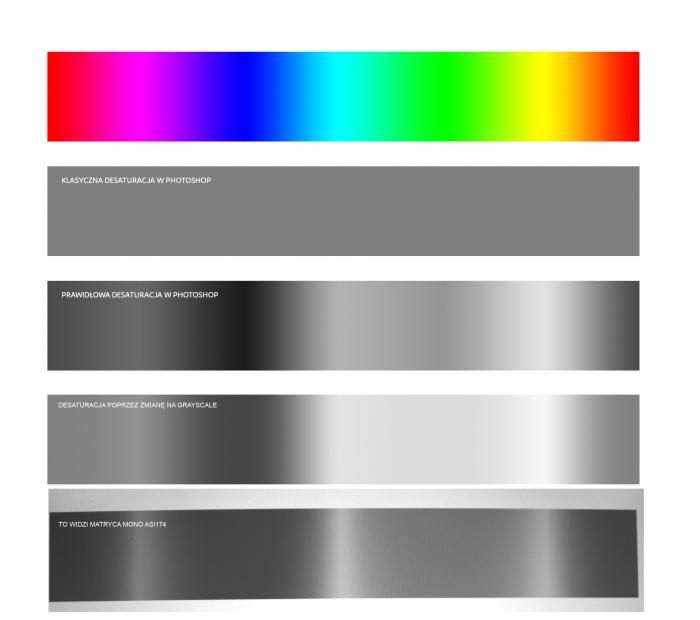

Pamiętaj, że twoja kamera i monitor inaczej będzie odpowiadać na czarno-biały gradient, a inaczej na kolorowy. Przecież to niekoniecznie jest to samo. Desaturację można zrobić na wiele sposobów, co więcej, żadnen tak naprawdę nie jest obiektywny i podlega interpretacji.

Kamery mono też nie są obiektywne, bo mają bardzo różną reakcję na dane spektrum.

Tu nie chodzi o to, żeby wchodzić głęboko w fizykę. Celem desaturacji jest pokazanie dynamiki tonalnej (nie może jej zabijać). Tym postem chciałem tylko uczulić, żeby mieć świadomość, że desaturacja z automatu może zniszczyć bardzo wiele w luminancji (jeżlei chcemy np. zrobić z RGB mono i używać w kompozycie jako L).

Ale zgadzasz się, że chodzi tu o wykres QE matrycy w zależności od częstotliwości? To jest winowajca? Gdyby maska bayera oraz matryca miały prostokątną charakterystykę, to średnia byłaby ok? To w takim razie zastanawiam się, czemu w danych raw (lub fits) nie ma zawartych informacji o charakterystyce użytej matrycy? Wówczas można by robić tą desaturacje idealnie (a może i inne czynności też).

-

Przez was musiałem zrobić test

Sprawdziłem, jak ten obrazek Adama wygląda po desaturacji "fizycznej", czyli po prostu na zdjęciu z monochromatycznej matrycy (ASI174MM). Chyba nie będzie nadużyciem powiedzenie, że takie zdjęcie to wierny sposób desaturacji. I co wyszło?

Sprawdziłem, jak ten obrazek Adama wygląda po desaturacji "fizycznej", czyli po prostu na zdjęciu z monochromatycznej matrycy (ASI174MM). Chyba nie będzie nadużyciem powiedzenie, że takie zdjęcie to wierny sposób desaturacji. I co wyszło?Twoja "prawidłowa" desaturacja Adamie coś nie do końca jest prawidłowa

Ale faktycznie istotnie lepsza, niż zwykłe uśrednienie (czyli środkowy pasek). Ten test przekonał mnie wreszcie, że coś jest na rzeczy i to nie prosta sprawa.

Ale faktycznie istotnie lepsza, niż zwykłe uśrednienie (czyli środkowy pasek). Ten test przekonał mnie wreszcie, że coś jest na rzeczy i to nie prosta sprawa.W PSie jest jeszcze jedna opcja desaturacji poza operacją "desaturate". Otóż można zmienić tryb na "grayscale". I co ciekawe, efekt jest jeszcze inny, niż w pozostałych przypadkach (ale niezły)

Ja do tej pory tak się pozbywałem koloru.

Ja do tej pory tak się pozbywałem koloru.Poniżej zestawienie wszystkich wyników (obrazu z kamerki oczywiście nie da się idealnie dopasować jeśli chodzi o jasność itp z wielu względów, ale poglądowo jest ok; rzetelnie można go porównać na poprzednim obrazku).

Czy w całym zagadnieniu chodzi o uwzględnienie charakterystyki QE matrycy od długości wali? To wydaje mi się logiczne. Tylko jak to zrobić, nie znając tej charakterystyki? Jest przyjmowany jakiś uniwersalny, przybliżony model?

-

1

1

-

-

Robiąc ten film zastanawiałem się, czy poruszyć kwestię modelu koloru (Lab/RGB). Wydwało mi się to takie trywialne. Cieszę się, że komuś się jednak przyda.

Zakładam klub oświeconych - którzy o istnieniu Lab nie mieli pojęcia

Wielkie dzięki za filmik, dla mnie bardzo wartościowy, jak pewnie dla wielu innych. Nie wiem, jak wy się z tym lab mogliście tyle kryć, na Astropolis nigdy o tym nie słyszałem...

Wielkie dzięki za filmik, dla mnie bardzo wartościowy, jak pewnie dla wielu innych. Nie wiem, jak wy się z tym lab mogliście tyle kryć, na Astropolis nigdy o tym nie słyszałem...No i już wiem, skąd co poniektórzy czarowali te kolory na astrowizji - kolorystyka, którą uzyskałeś jest bardzo charakterystyczna, ma taki "styl", który wyróżnia kilku naszych astrofotografów. Zresztą bardzo mi się on podoba, ale nie miałem pojęcia, jak go wyczarować.

Szczerze mówiąc wciąż nie rozumiem, czemu zmiana tego trybu ma prawo cokolwiek zmienić... Zdaję sobie sprawę, że zmiana nasycenia to zapewne dość złożony algorytm, a nie prosta operacja matematyczna i stąd może te różnice wynikają. Wiem tylko tyle, że jakimś sposobem na zmianę saturacji jest konwersja do HSV, zmiana S i powrót do RGB

Sam tak zresztą robiłem w swoim programiku kiedyś. Ale czy PS tak robi, to już nie wiem. No i ciekawe, co się dzieje w tym całym Lab.

Sam tak zresztą robiłem w swoim programiku kiedyś. Ale czy PS tak robi, to już nie wiem. No i ciekawe, co się dzieje w tym całym Lab.Desaturować RGB nie wolno (w zwykły sposó

, bo też następuje oszustwo. Będzie o tym w następnym filmiku

, bo też następuje oszustwo. Będzie o tym w następnym filmiku

A poniżej przykład - jak to wygląda w praktycje. Słabo.

Hmm,hmm,hmm. Tu to mnie zupełnie zaskakujesz. Zawsze uważałem, że desaturacja to zwyczajne policzenie średniej dla składowych RGB i wpisanie tego do monochromatycznego piksela. To jest proste i logiczne. Szczerze mówiąc nie mam pojęcia, co tu można zmienić i dlaczego... ale się pewnie dowiem

-

Czy my już trochę nie przeginamy? Kiedyś przyglądaliśmy się zdjęciom astro 1:1 (co już było dosyć ekstrawaganckie w całej dziedziwnie fotografii). Teraz widzę, że będziemy zoomować 10x i szukać takich wad. Serio Wam to przeszkadza?

No ale takie rzeczy widać nawet na 50%, także spokojnie

-

Maxim ma możliwość alignowania klatek po danych astrometrycznych (czyli o subpikselowej precyzji), więc nic lepszego nie może być. Pewną miekkość klatka dastaje zawsze, jeżeli przy alignacji ulega rotacji/przeskalowaniu. To naturalne. Różnice będą wtedy, jężeli np. inna aplikacja użyje algorytmu wyrównywania na bazie prostego przesuwania X i Y (przy przyzwoicie ustawionej polarnej tak powinno być wyrównane zdjęcie) podczas kiedy maxim zawsze z defaultu wybierze opcję rotowania i skalowania (czasami o setne stopnia, zupełnie bez znaczenia dla sztuki, ale faktycznie minimalnie degradujące ostrość przez resampling). Oczywiście można ręcznie wybrać w Maximie wyrównywanie bez skalowania/rotacji. Pytanie tylko, kto tak robi

A powiedz Adam, jaki program polecasz do alignacji "lokalnej", czyli takiej, która umie miejscowo rozciągać obraz? Potrzebuję takiej, aby wyrównać geometrię obrazu po flipie, gdzie błędy kolimacji przeszły na drugą stronę. W efekcie zwykła alignacja z przesuwaniem i skalowaniem nie wystarcza - pół obrazka jest ok, a w drugiej połowie gwiazdy nie trafiają w siebie. Niestety Maxim nie ma czegoś takiego. Ma to np Autostakkert, ale nie widzę jak w nim zapisać klatki po alignowaniu. Słyszałem, że jest to w Pixie, ale nie mam jego pełnej wersji. Gdzieś jeszcze to jest?

-

Bardzo fajne próby. Też się tak bawiłem kilka razy

Na Twoich filmikach brakuje tylko poprawnej debayeryzacji - byłby kolor zamiast brzydkiej kratki.

Na Twoich filmikach brakuje tylko poprawnej debayeryzacji - byłby kolor zamiast brzydkiej kratki. -

Dokładnie o to chodzi. Obecnie bez zapamiętywania ostatniej pozycji używanie focusera na przemian manualnie i spod maxima jest super niewygodne. Załóżmy taką sytuację: wyciągam teleskop ze skrzyni transportowej. Następnie zakładam na montaż i chcę wysunąć, całkowicie schowany na czas transportu, focuser by móc przykręcić kamerę z całym osprzętem. Wyłączam wszystko by nie marnować prądu i zestaw chłodząc się czeka na noc astronomiczną. Po włączeniu zestawu sterownik widzi pozycję 0.

Hmm, trochę dziwnie go używasz

Po pierwsze, pobór prądu w czasie spoczynku to ok 0,1A, czyli raczej mało. No ale jak chcesz go koniecznie wyłączyć, to wystarczy przed tym go zaparkować. Tak samo, jak się robi z montażem. Czyli odpalasz w pozycji zero, wysuwasz, mocujesz kamerę, parkujesz, wyłączasz i po włączeniu jest dobra pozycja.

Po pierwsze, pobór prądu w czasie spoczynku to ok 0,1A, czyli raczej mało. No ale jak chcesz go koniecznie wyłączyć, to wystarczy przed tym go zaparkować. Tak samo, jak się robi z montażem. Czyli odpalasz w pozycji zero, wysuwasz, mocujesz kamerę, parkujesz, wyłączasz i po włączeniu jest dobra pozycja. -

Tak właśnie nie działa

Podejrzewam, że problem leży w braku sekcji DefaultInstall, której nie posiadają podpisane sterowniki (a taki mam). Ale nie wiem, czy powinienem po prostu uruchomić z podaniem innej sekcji, czy w ogóle w inny sposób. Tu jest sterownik, o który mi chodzi: https://drive.google.com/file/d/0B-RoEs6iYHu2dnk4QXZxYlVjd2M/view?usp=sharing

Podejrzewam, że problem leży w braku sekcji DefaultInstall, której nie posiadają podpisane sterowniki (a taki mam). Ale nie wiem, czy powinienem po prostu uruchomić z podaniem innej sekcji, czy w ogóle w inny sposób. Tu jest sterownik, o który mi chodzi: https://drive.google.com/file/d/0B-RoEs6iYHu2dnk4QXZxYlVjd2M/view?usp=sharingHmm, jaki system ? To widziałeś https://community.spiceworks.com/topic/1702844-install-inf-file-from-cmd ?

To ma działać na każdym systemie z przedziału XP - 10. A testuję obecnie na Win10 64 bit. Niestety, to rozwiązanie odpada, bo nie wspiera XP. A do tego nawet na Win10 nie chce pójść - nie wiedzieć czemu, system nie widzi tego pnputil (nawet, jak chcę go odpalić z katalogu, w którym się znajduje exe).

-

Przeczytaj drugą część pierwszego posta: http://astropolis.pl/topic/48799-najdokladniejsza-i-najszybsza-metoda-ustawiania-montazy-sw-synscan-na-biegun/

-

Nie wiem w czym robisz instalator. Bawiłem się kiedyś w Inno Setup i tam można było uruchamiać skrypty związane z dowolnym poleceniem systemowym lub wstawki pisane w Delphi więc powinno się udać z uruchomienie pliku inf z jakimś magicznym przełącznikiem ... Może przez polecenie systemowe https://msdn.microsoft.com/en-us/library/windows/desktop/bb776886(v=vs.85).aspx ?

To akurat ma być uruchamiane nie z instalatora, a sterownika ascom (czyli zwykłego kodu c#). Chciałem to zrobić na zasadzie stosownego polecenia cmd. A w Inno Setup też pewnie będę musiał coś podobnego dołożyć, ale to jeszcze nie teraz.

-

Hej, istnieje możliwość wzbogacenia focusera o zapis aktualnej pozycji i przechowywanie jej po wyłączeniu urządzenia?

Chodzi o taki auto zapis, że masz pozycję np 2000 ustawioną i po ponownym uruchomieniu bez robienia dodatkowych czynności dalej jest 2000? A może zapis kilku pozycji typu "kamera", "okular1" itp i wybierania ich z listy, żeby się ustawił? Drugą rzecz chcę w najbliższym czasie dodać, a o pierwszej pisała mi już jedna osoba i nad tym też pomyślę. Z tym że pierwsza funkcja jest nieco problematyczna w dodaniu, ale spróbuję.

A przy okazji: Właśnie siedzę nad softem i próbuję zautomatyzować proces instalacji sterowników USB, tak żeby było ekstra wygodnie. Jeśli ktoś wie, jak zainstalować plik .inf z linii poleceń, to będę wdzięczny za wsparcie

Próbuję różnych metod i coś nie idzie.

Próbuję różnych metod i coś nie idzie. -

-

Działający. Tak jak pisałem - to bardziej uporządkowana forma tego, co i tak robię na forum. Mam mniej pracy z wysyłaniem ofert, czy numeru konta, itp

No i nie nazywałbym tego sklepem - to raczej taki malutki "butik" astro.

Adam, super sprawa! Miło popatrzeć na fajny sprzęt i to w dobrych cenach

Życzę powodzenia!

Życzę powodzenia!A co do TPL, to jak porównałem kilka kamerek, to jednak Adam wypadasz lepiej

Choć TPL zawsze miało dobre ceny, to u Ciebie jest jeszcze fajniej. No szkoda, że ZWO nie dotrzymało słowa. Choć konkurencja jest raczej pozytywnym czynnikiem napędzającym rozwój.

Choć TPL zawsze miało dobre ceny, to u Ciebie jest jeszcze fajniej. No szkoda, że ZWO nie dotrzymało słowa. Choć konkurencja jest raczej pozytywnym czynnikiem napędzającym rozwój. -

-większy piksel zbiera więcej światła - po prostu ma większą powierzchnię, więc trafi do niego więcej fotonów

A to nie będzie to samo jak na danej powierzchni jednego pixela będzie ich np. 5 - nie zbiorą taką samą ilość światła łącznie?

Sumarycznie tak. Ale chodzi o to, jak to światło zostanie spożytkowane. Jak trafi na jeden, duży piksel, to będziemy mieli tam mocny sygnał (czyli złapiemy słabe obiekty), ale z małą szczegółowością. Kilka mniejszych pikseli zapewni lepszy szczegół, ale gorszy snr, czyli nie zarejestrujesz tak słabych obiektów. Z tym zagadnieniem wiąże się binning - czyli łączenie wartości sąsiednich pikseli np w kwadracie 2x2, żeby zrobić z nic wirtualny, większy piksel. Taką sztuczkę stosuje się, gdy nie zależy nam bardzo na szczególe, tylko zasięgu (ilości sygnału), np robiąc RGB. RGB zbierane z bin2 może być naświetlane znacznie krócej, niż L bez bin, ale kosztem gorszego szczegółu. Z tym, że bining to funkcja sprzętowa jedynie kamer dedykowanych - w lustrzance, czy telefonie (hahaha) próżno jej szukać. I nie można jej zastąpić zwykłym dodawaniem wartości z pikseli w programie na kompie, bo dodawanie musi się odbyć przed odczytem z matrycy, aby tylko raz dodać szum odczytu (a nie 4 razy, bo cały zysk znika).

Także pod tym względem mniejszy piksel jest lepszy (w foto planet np zastępuje niejako barlowa), bo widzimy bardziej szczegółowo. Ale jeśli piksel jest mniejszy, to dla zachowania tak samo dużej matrycy musi tych pikseli być więcej, co przekłada się na wzrost ceny. A jak nie zwiększymy ilości pikseli, a zmniejszymy ich rozmiar, to zrobi nam się g***o, a nie matryca - jak w telefonie

No to jak?, piszesz że większa ilość upchanych pixeli na matrycy daje obraz bardziej szczegółowy, a wcześniej że mniejsze zbierają mniejszą ilość światła. No to się chyba samo wyklucza?. Jaka jest minimalna przekątna matrycy dla "X" pixeli?, ma ktoś taką wiedzę?.

Nie, to są dwie zupełnie odmienne sprawy. Ilość zbieranego światła determinuje, jak szybko zbieramy materiał. A skala zdjęcia określa jego szczegółowość, czyli jak drobne szczegóły można na nim rozróżnić (i nie ma to żadnego związku z ilością światła). Dwukrotne zwiększenie skali (czyli zwiększenie rozmiaru piksela 2x) możesz sobie zasymulować zmniejszając rozdzielczość jakiegoś zdjęcia 2x na kompie. Co się stanie ze szczegółami?

Wielkość piksela jest kluczowa przy wyorze optymalnego teleskopu dla kamery. Jeśli kupujemy coś z małym pikselem, to nie powinniśmy szaleć z ogniskową (jeśli mówimy o DS), bo montaż nie da rady ze skalą. Na ogół większy piksel pozwala na większe teleskopy przy tej samej skali.

No właśnie próbuję coś bardzo ekonomicznego stworzyć na początek dla swojego refraktora 4' F6,6 - dlatego chcę wykorzystać zepsuty telefon gdzie kamera działa,po prostu ją wyciągnę i oprawię w mocowanie okularu. Tylko do końca nie wiem na jakie parametry kamery patrzeć. Na początek avi Księżyca i planet.

W wypadku US małe piksele telefonu są akurat zaletą, bo zależy nam na skali. Ale z drugiej strony taka kamera będzie miernej jakości, jak na nasze standardy i co najważniejsze, raczej nie da możliwości w pełni ręcznego doboru parametrów i zapisu do niekompresowanych plików. W przypadku US kluczową rzeczą jest też (a nawet przede wszystkim) prędkość rejestracji - czyli ilość zdjęć na sekundę. Tu też telefon polegnie. Bo zauważ, że pełną informację wyciągasz z matrycy tylko robiąc zdjęcie (wtedy rejestrujesz każdy piksel), a nagrywając film dokonywane jest jakieś przeskalowanie zmniejszające rozdzielczość i w efekcie traci się masa informacji o obrazie (w sposób trudny do przewidzenia).

Jeszcze raz zachęcam do czytania forum, bo wszystko co tu napisałem ja i inni było już powiedziane wielokrotnie. Sprawa nie jest trywialna, żeby ją wyjaśnić jednym zdaniem, a nawet całym wątkiem.

-

Wielkość piksela ma znaczenie fundamentalne i możesz o tym przeczytać w dziesiątkach wątków na forum. W skrócie:

-większy piksel zbiera więcej światła - po prostu ma większą powierzchnię, więc trafi do niego więcej fotonów

-większy piksel ma na ogół niższy szum (jeśli patrzymy na matryce podobnej generacji)

-większy piksel ma na ogół większą pojemność studni (może pomieścić więcej fotonów przed nasyceniem (przepaleniem)

-rozmiar piksela determinuje skalę zdjęcia: skala[rad/pix] = rozmiar_pix / ogniskowa. Czyli im większy jest piksel, tym większy kawałek nieba przypada na niego, a więc widzimy go mniej szczegółowo. Także pod tym względem mniejszy piksel jest lepszy (w foto planet np zastępuje niejako barlowa), bo widzimy bardziej szczegółowo. Ale jeśli piksel jest mniejszy, to dla zachowania tak samo dużej matrycy musi tych pikseli być więcej, co przekłada się na wzrost ceny. A jak nie zwiększymy ilości pikseli, a zmniejszymy ich rozmiar, to zrobi nam się g***o, a nie matryca - jak w telefonie

Bo wielkość matrycy determinuje z kolei pole widzenia zdjęcia.

Bo wielkość matrycy determinuje z kolei pole widzenia zdjęcia.-lepsza skala (bardziej szczegółowa) ma też swoje wady - wyraźniej ukazuje wszelkie aberracje teleskopu, niedokładności kolimacji itp. Czyli staje się bardziej wymagająca.

Wielkość piksela jest kluczowa przy wyorze optymalnego teleskopu dla kamery. Jeśli kupujemy coś z małym pikselem, to nie powinniśmy szaleć z ogniskową (jeśli mówimy o DS), bo montaż nie da rady ze skalą. Na ogół większy piksel pozwala na większe teleskopy przy tej samej skali.

-

Niemożliwe. Dokręcałeś śrubę do regulacji docisku?odnosnie tego wyciagu i twoich rozwiazan, to ja jeste na etapie oczekiwania na przesylke http://www.teleskop-express.de/shop/product_info.php/info/p5769_TS-Optics-2-5--Rack-and-Pinion-Focuser---holds-Acc--up-to-6-kg---travel-65-mm.html

nic innego wg mnie nie ma sensu i jest tylko wyrzuceniem kasy.

moj wyciag najzwyczjniej na swiecie nie jest w stanie wciagnac drawtube na ktorej wisi lacznie 1kg sprzetu - slizga sie.

Myślałem, że to o ugięcia chodzi.

-

Zauważyłem pewną zasadę dotyczącą tej kamery obrabiając materiał z dłuższym czasem.

Im krótszy czas naświetlania tym bardziej zaszumiony stack. W przypadku stacku z podobnej liczby klatek co kometa ale przy dłuższych czasach, szum jest zdecydowanie łatwiejszy do usunięcia / zarządzenia.

Hmm, ale czy to nie jest oczywiste?

Istotna jest zasadniczo łączna długość akwizycji. A przy kamerce z małym szumem odczytu znaczenie traci sposób podziału tego czasu na pojedyncze klatki. Ale jaka by matryca nie była, to np 2x większa ilość materiału musi dać mniejszy szum.

Istotna jest zasadniczo łączna długość akwizycji. A przy kamerce z małym szumem odczytu znaczenie traci sposób podziału tego czasu na pojedyncze klatki. Ale jaka by matryca nie była, to np 2x większa ilość materiału musi dać mniejszy szum. -

Witaj

Już możesz pisać, wreszcie zwolniłem więcej miejsca w tej skrzynce... Jak coś, to mam te mocowania od ręki za 50 zł + 10 zł wysyłka. Ale może ktoś się znajdzie, co nie potrzebuje i od niego weźmiesz. Jak coś, to czekam na wiadomość.

-

Mam pytanie, czy taka ilość hot pixeli to normalne?

Kupiłem niedawno canona 450d (używkę) i powiedzmy że ich ilość na mojej matrycy jest porównywalna z kolegi zdjęciem.

Powiedziałbym, że na tym zdjęciu widać ich dość mało (pewnie przez resize)

Lustrzanki sieją hotami jak szalone.

Lustrzanki sieją hotami jak szalone.

Koma | korektor komy, kolimacja

w Dyskusje o sprzęcie

Opublikowano

Ta odległość jest podana w INSTRUKCJI, oraz w kilku innych miejscach, jak w tym fajnym zbiorze: https://en.wikipedia.org/wiki/Flange_focal_distance.

Wynosi 46,5 mm.

Ponadto, możesz prawie na pewno przyjąć, że do założeniu T-Ringa backfocus wzrasta do 55 mm, to taki standard.

Jeśli uda Ci się cokolwiek precyzyjnie zmierzyć względem tego znacznika, to dostaniesz ode mnie nagrodę pierwszego mierniczego Jak wyżej pisałem, odległość od matrycy do bagnetu jest znana, a od bagnetu można znacznie precyzyjniej coś zmierzyć.

Jak wyżej pisałem, odległość od matrycy do bagnetu jest znana, a od bagnetu można znacznie precyzyjniej coś zmierzyć.