-

Postów

92 -

Dołączył

-

Ostatnia wizyta

Typ zawartości

Profile

Forum

Blogi

Wydarzenia

Galeria

Pliki

Sklep

Articles

Market

Community Map

Treść opublikowana przez GrzegorzP

-

Pixinsight potrzebna pomoc - DBE

GrzegorzP odpowiedział(a) na Afur temat w Dyskusje o astrofotografii

Zdecydowanie sample ustawione na obiekcie - widać po wynikowym modelu tła. Jeżeli zdjęcie zawiera tylko gradient, tzn. został prawidłowo przeprowadzony preprocessing (w szczególności flat), to teoretycznie wystarczą cztery sample ustawione po narożnikach i gradient powinien być prawidłowo zdjęty (czysty gradient równomiernie rośnie/maleje w jednym kierunku). To oczywiście teoria i prawie zawsze coś tam zostaje, ale zacząłbym od takiego układu sampli i zobaczył co z tego wyjdzie (jeżeli był flat). -

wyzwanie Jak dobrze można ustawić montaż na biegun niebieski w dzień?

GrzegorzP odpowiedział(a) na Behlur_Olderys temat w Astronomia teoretyczna

Metoda obserwatorów zaćmień Słońca (gdy trzeba "zebrać się" ze sprzętem i ponownie rozłożyć w dzień): - ustawić się w nocy możliwie blisko miejsca obserwacji zaćmienia, - montaż wypoziomować na podstawie poziomnicy, - ustawić na biegun (lunetka/dryf), - trwale przymocować kompas tak żeby wskazywał północ, - poskładać sprzęt nie urywając kompasu:). Następnego dnia rozkładamy wszystko ponownie, poziomujemy i orientujemy montaż zgodnie ze wskazaniem kompasu. W przypadku zaćmienia sprawdza się nieźle, ale w astrofoto dłuższą ogniskową raczej nie będzie wystarczające. Przy krótkich (<=100mm) nawet przemieszczając się o kilka/kilkanaście kilometrów nie bawiłem się w ustawianie lunetką (Sigma Octantis to jakaś pomyłka, którą jak najszybciej trzeba poprawić). Na początku ustawiłem elewację i nie ruszałem, później tylko poziomowanie i AZ na podstawie kompasu - szło całkiem nieźle, -

Można - to tylko kwestia odległości telefonu od planety...

-

Jesteś pewien, że żadna z klatek nie "wyskoczyła" poza kadr? Czasami tak mam gdy pojedyncze klatki są mocno przesunięte względem pozostałych - program szuka części wspólnej dla całego zestawu.

-

Sam jestem wielkim entuzjastą Pix-a (byłem jeszcze w czasach, gdy niektórzy psy na nim wieszali ), ale dożywotniej licencji chyba nie ma. O ile dobrze pamiętam, to Juan obiecuje bezpłatne aktualizacje wersji 1.xx i kiedyś wspominał o opłacie gdy pojawi się wersja 2.0. Z drugiej strony patrząc na to jak powoli rosną cyferki za jedynką, to może faktycznie będę miał dożywotnio

-

[S] Optolong L-pro eos-ff clip - cegiełka dla Ukrainy

GrzegorzP odpowiedział(a) na janekosa temat w Giełda: Archiwum

Biorę, poszło PW -

Kierunek i obciążenie z biegiem czasu się zmienia - może to jest problem? Kiedyś myślałem nad takim "inteligentnym" PEC, który uśrednia korekty w każdym kolejnym okresie napędu - mógłby się adaptować do powolnych zmian. Miało być softwarowe w połączniu z programem do guide - z braku czasu na koncepcji się zakończyło :).

-

Problemy z kalibracją materiału.

GrzegorzP odpowiedział(a) na tex88 temat w Dyskusje o astrofotografii

Miałeś wyłączoną opcję "Optimize" w sekcji "Master dark" okienka ImageCalibration? (domyślnie jest włączona). Optymalizacja dark-ów może przeskalować ciemną klatkę małym współczynnikiem (np. 0.5), co w przypadku kamer z mocnym ampglow doprowadzi do pozostawienia niepożądanego sygnału. -

Problemy z kalibracją materiału.

GrzegorzP odpowiedział(a) na tex88 temat w Dyskusje o astrofotografii

Zdecydowanie zrobił kalibrację bez problemów. Nie wiem co może być nie tak (może wersja? - ja pracowałem na aktualnej) -

Problemy z kalibracją materiału.

GrzegorzP odpowiedział(a) na tex88 temat w Dyskusje o astrofotografii

Nie dostrzegam jakichkolwiek problemów z kalibracją tego materiału. Po pierwsze nie powinieneś obracać klatek - po flipie obraz jest odwrócony, ale ampglow zostaje z tej samej strony matrycy. Zrobiłem tak: 1. Odwróciłem Twoje klatki o 180 stopni (przywracając oryginalną orientację względem dark-a). 2. Wrzuciłem wszystko do IC i skalibrowałem Twoim biasem, dakniem i flatem 3. Wynik wrzuciłem do SA (niczego nie obracałem), jako referencyjną wybrałem pierwszą nieobróconą klatkę. 4. Wyrównane klatki zestakowałem w II. Wszystko na domyślnych parametrach. Dołączam moje procesy (zapisane z pix-a 1.8.8-9). Wynik (skalowane na 25%) proc.zip -

Koniunkcja Jowisza z Saturnem 20-22.12.20

GrzegorzP odpowiedział(a) na wismat temat w Planety i Księżyc

U mnie się otwiera - fajne. Tylko jedna uwaga: to nie mogło być w czasie największego zbliżenia, widać Księżyc więc musiało być robione 17.12. W sumie nawet lepiej, fotka zyskała na atrakcyjności -

I wszystko byłoby jasne, tylko nie rozumiem dlaczego w takim razie chciałeś kompilować kod programu na komputerze w obserwatorium. Wydawało mi się, że to był początek problemów, ale być może czegoś nie zrozumiałem.

-

Dla pełnej jasności - nie teoretyzuję, bo używam Arduino w podobnych zastosowaniach. Np. ostatnio budowałem układ czujników rejestrujących wibracje układu mechanicznego ramienia robota.

-

Program nie działa na Twoim komputerze tylko na Arduino - w sumie to jest taki "komputer" z własnym procesorem i RAM-em. Jeżeli wgrasz go na flasha, to on tam siedzi na stałe i jeżeli podłączysz zasilanie, to zostanie uruchomiony. Nie potrzebuje do tego komputera, działa i cały czas wysyła dane na serial niezależnie od tego czy Arduino jest połączone z komputerem. Komputer potrzebujesz tylko do odbierania danych. Gdybyś np. dodał do układu moduł BlueTooth, to mógłbyś to odbierać bezprzewodowo.

-

Jak rozumiem już działa, ale tak dla pełnej jasności: jeżeli w domu załadowałeś program do Arduino, to on jest w pamięci i działa. W obserwatorium niczego nie musisz kompilować (weryfikować) ani ładować. Wystarczy połączyć z komputerem, odpalić monitor/kreślarkę z oprogramowania (lub jakikolwiek inny terminal obsługujący COM-a) i możesz monitorować to co przesyła. Chyba, że masz dwa Arduino - jedno testujesz w domu, a drugie na stałe w obserwatorium.

-

Mam tylko jedno pytanie: dlaczego musisz ładować program na Arduino na komputerze w obserwatorium? Jeżeli załadujesz program w domu, to on tam będzie i będzie wysyłał dane na port. Jeżeli musisz (chcesz) odbierać to przez aplikację Arduino, to wystarczy, że postawisz ją na komputerze, otworzysz monitor/kreślarkę i informacje powinny spływać.

-

Koniunkcja Jowisza z Saturnem 20-22.12.20

GrzegorzP odpowiedział(a) na wismat temat w Planety i Księżyc

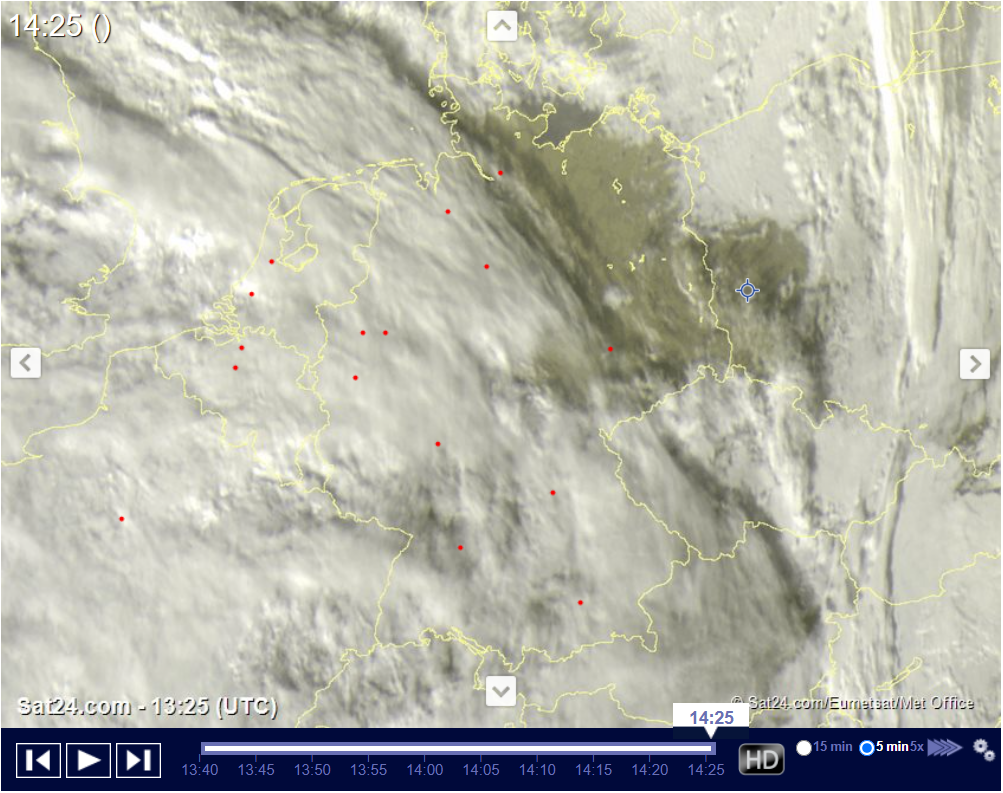

To był długi i pracowity dzień, ale veni, vidi, vici Wbrew zdrowemu rozsądkowi, gdy zobaczyłem taki obrazek na sat 24 (zapisałem sobie w folderze z materiałem z obserwacji): ...postanowiłem, że wybiorę się jednak do obserwatorium. "Veni" ok 15:30. Szybki montaż LX-a na pierze i ustawienie na Księżyc (po takim wstępnym wyrównaniu można już mniej-więcej trafić przy pomocy goto). Ok. 16:05 "vidi" - Jowisz w szukaczu, chwilę później na ekranie. Ostrość (pływały jak pstrągi w górskim potoku) i o 16:08 pierwsze "vici": LX200 8", f/10, ASI178MM, t=15ms z filtrem IR, 500/1000 klatek Autostakkert!3+Registax6), lekko kadrowane i pomniejszone na 50% (na razie szybko poskładane z pierwszego nagrania - nie mogłem wytrzymać) Później było jeszcze kilka "vici" z różnymi parametrami, na nieco ciemniejszym niebie (do 16:50), więc kontrasty powinny być lepsze. Łapałem też nieco szerzej, więc powinien pokazać się jeszcze Callisto i dwie gwiazdki z tła, ale na to potrzebuję więcej czasu. Gdy kończyłem sytuacja wyglądała tak: -

Koniunkcja Jowisza z Saturnem 20-22.12.20

GrzegorzP odpowiedział(a) na wismat temat w Planety i Księżyc

Miałem się wybrać do obserwatorium i założyć LX-a na piera, ale nie wyszło, więc poszalałem z Rubinarem na balkonie. Pierwszy raz od nie wiem ilu lat przykręciłem telekonwerter (oczywiście do pary TK-2M) i strzelałem z 2 metrów. Ustawianie ostrości tym obiektywem to jakaś porażka, więc taki trochę miękiszon wyszedł - w sumie dziwne, że widać, że pierścień to pierścień. Zrobiłem po kilkanaście klatek - spróbuję coś poskładać. Na razie pojedyncza fotka. EOS-R + Rubinar 1000mm x2, f/20, t=1s, 400ISO prowadzone na Takahashi Sky Patrol III -

Koniunkcja Jowisza z Saturnem 20-22.12.20

GrzegorzP odpowiedział(a) na wismat temat w Planety i Księżyc

...ale nie pasuje do aktualnej konfiguracji. -

Koniunkcja Jowisza z Saturnem 20-22.12.20

GrzegorzP odpowiedział(a) na wismat temat w Planety i Księżyc

Wszystko EOS-R, kadrowane do ok. 50% 18.12.2020 na początek na jasnym jeszcze niebie. Rubinar 1000mm, f/10, t=1s, 800ISO Canon 70-200L F/2.8 + ExIIIx2, 400mm, f/5.6, t=1/2s, 400ISO I nieco później Canon 70-200L F/2.8 + ExIIIx2, 400mm, f/6.3, t=5s, 400ISO. Nisko było więc siedziało już głęboko w miejskim "sosie" -

Koniunkcja Jowisza z Saturnem 20-22.12.20

GrzegorzP odpowiedział(a) na wismat temat w Planety i Księżyc

Trochę na szybko, nie było czasu na uczciwe chłodzenie - z zachodu błyskawicznie nadciągały chmury Szerzej z Księżycem: EOS R + 70-200 L/2.8 (@200mm, f/2.8,t=1/10s,400ISO) ...i bliżej EOS R + 70-200 L/2.8 + EXIIx2(@200mm, f/5.6,t=1/2s,400ISO), kadrowane 50% -

Męty w oczach - czy macie i czy przeszkadzają

GrzegorzP odpowiedział(a) na Matheo_89 pytanie w Pytania: Różne

Mam coś takiego przez większość czasu (nie muszę spoglądać w okular teleskopu). Rozmawiałem o tym z okulistą i odpowiedź standardowa - w pana wieku... Polecił mi taki suplement (jak każdy dobry diler dał bezpłatną próbkę ). Nazywa się to VITROFT i podobno częściowo rozpuszcza takie zmętnienia (nie na stałe). Wypróbowałem rok temu i wydaje się, że przez pewien czas było lepiej (albo siła sugestii). W tym roku powtórzę i zobaczymy. Majątek to nie jest (przy kosztach sprzętu astro jak za darmo), duże opakowanie wystarcza na ok. 3-miesięczną kurację (tyle miałem brać). -

Pixinsight i za mało pamięci RAM ; czy stakować na raty?

GrzegorzP odpowiedział(a) na poldip temat w Dyskusje o astrofotografii

Moje 125 plików (28GB) przeszło bez problemów - zarówno zwykły stack jak i drizzle. Co do opcji "buffer size", to ostatni raz zmieniałem ustawienia na wersji 32-bitowej. W tamtym wypadku przy dużej liczbie plików faktycznie inaczej nie chciało składać. To było tak dawno, że dążyłem o niej zapomnieć :).