-

Postów

1 674 -

Dołączył

-

Ostatnia wizyta

-

Wygrane w rankingu

8

Typ zawartości

Profile

Forum

Blogi

Wydarzenia

Galeria

Pliki

Sklep

Articles

Market

Community Map

Treść opublikowana przez WielkiAtraktor

-

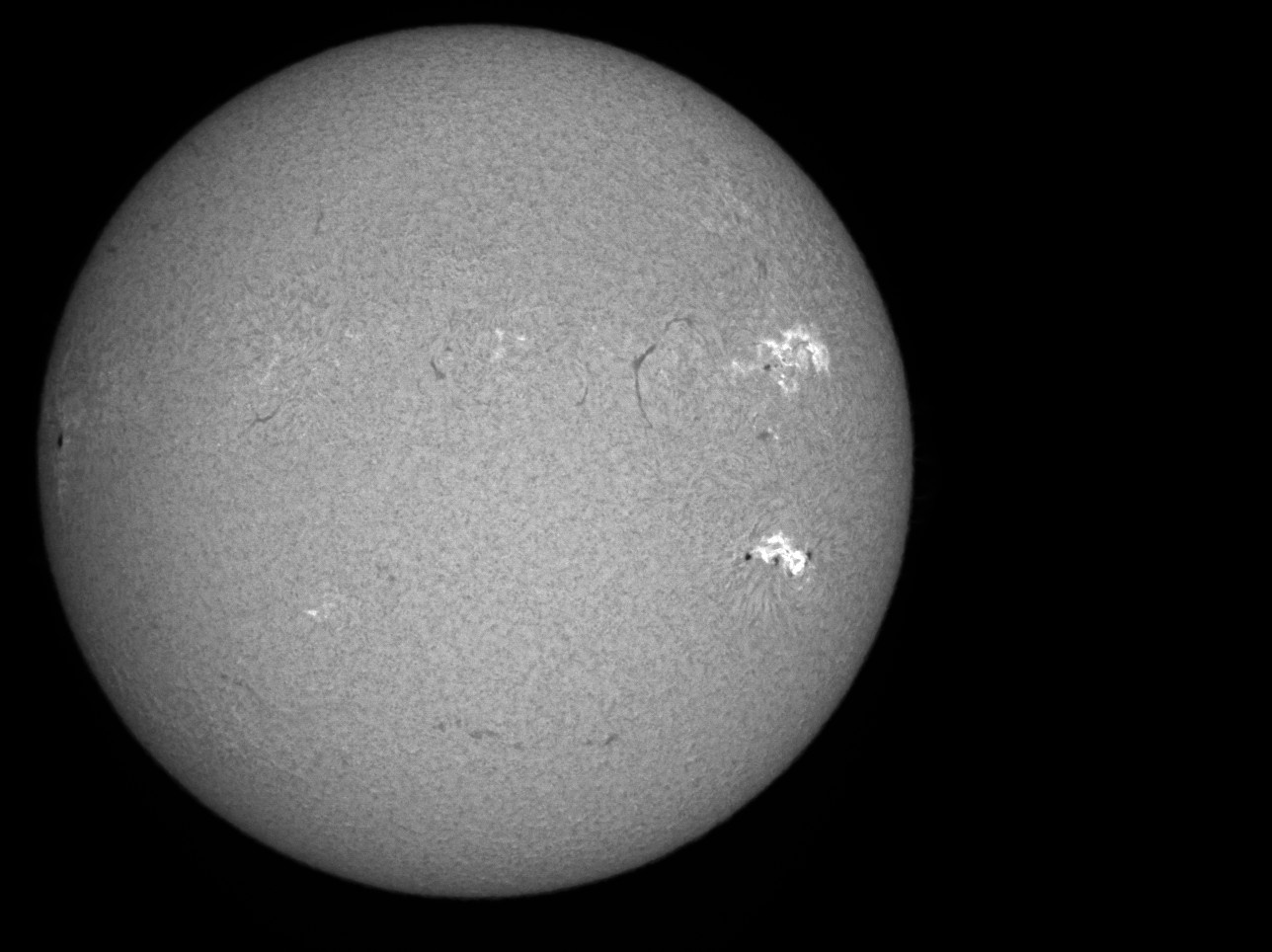

Zakończenie kilka lat temu produkcji Lunta 35 zasmuciło słoneczników. Ale oto następca: Lunt 40, już od $299 (!) z filtrem blokującym B500.

- Pokaż poprzednie komentarze 4 więcej

-

-

Chodzi o rozmiar obrazu w płaszczyźnie ogniskowej (a dokładniej to będzie 2 * f * tg(0.5°/2) ≈ 3,49 mm). Też nie wiem, po co akurat o tym wspominają (daliby obiektyw z f = 500 mm, to obraz byłby trochę większy, i vice versa...).

Grunt to pamiętać o tym, że filtr blokujący B400 ma na tyle przelotu, by zmieścić akurat całą tarczę z ogniskowej 400 mm (czyli mało/brak miejsca na duże protuberancje, jakbyśmy np. chcieli focić całość naraz), B500 - będzie miał pewien zapas wokoło, B600 - jeszcze większy zapas (no i mniejsze niż B600 będą winietować z popularnymi sensorami 1/3").

-

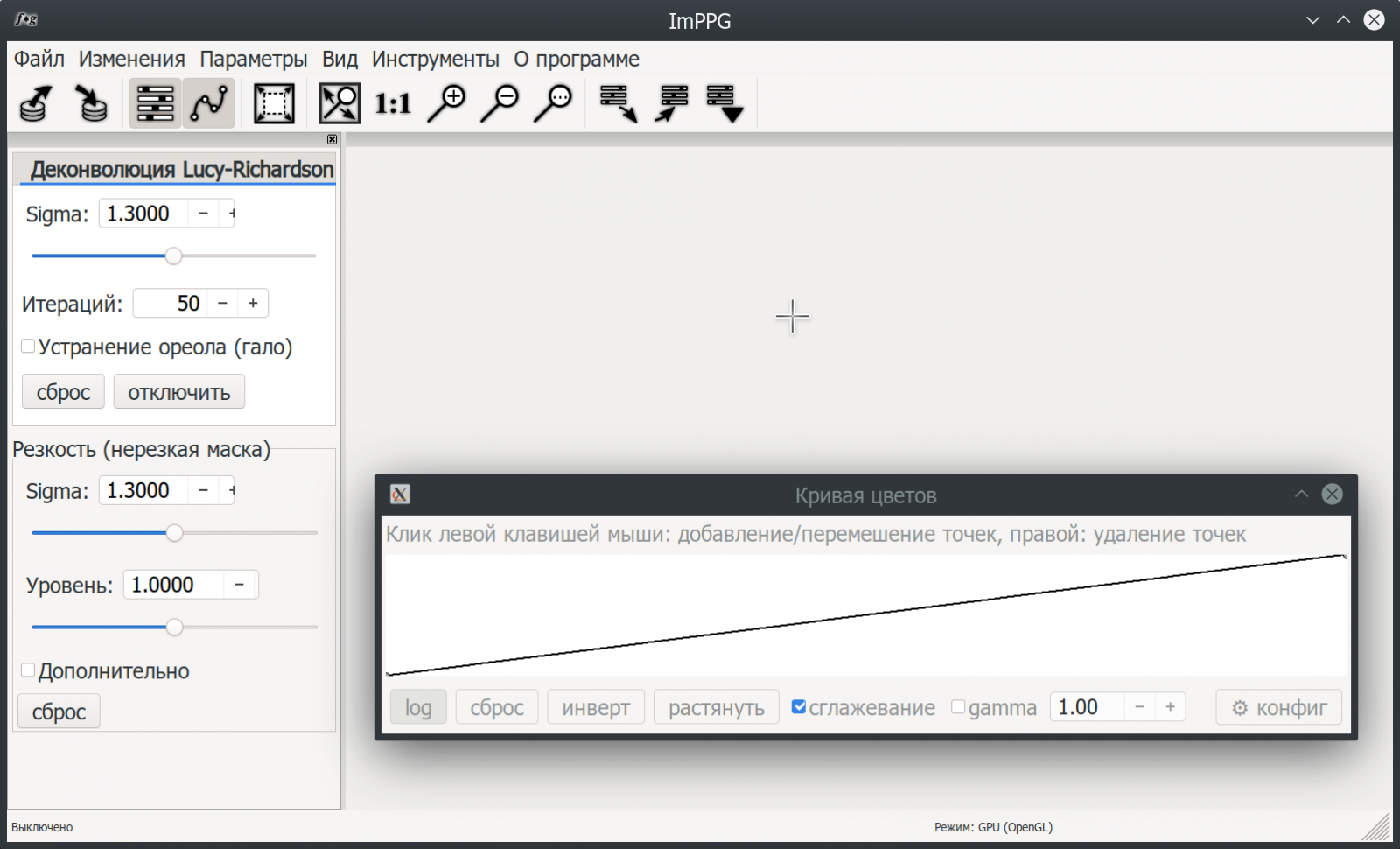

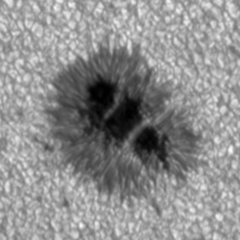

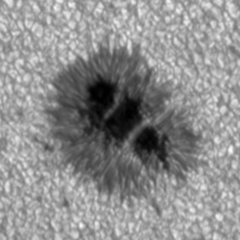

Na CN pojawiło się więcej szczegółow. Będzie dostępny moduł double-stack. Dla przypomnienia, wyniki Wojtka z Luntem 35 DS sprzed lat, link.